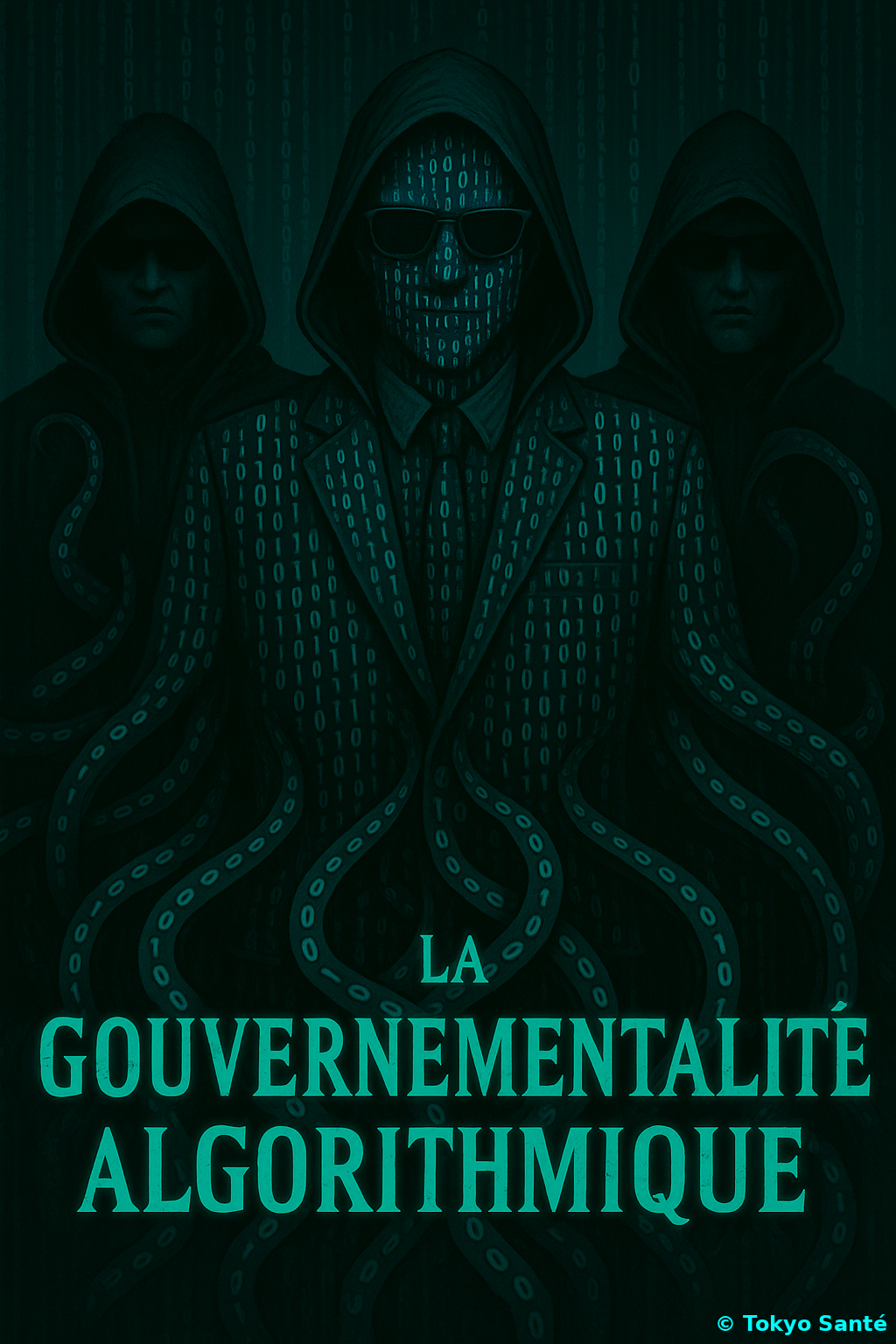

Le pouvoir n’a plus de visage. La gouvernance passe par la donnée, le costume par l’abstraction. Aucun sujet n’est visé, tout comportement est ajusté.

Quand l’algorithme gouverne sans Loi : sur la disparition du sujet dans les environnements numériques

On croit souvent que les algorithmes nous facilitent la vie : un trajet optimisé, une playlist personnalisée, une série recommandée au bon moment. Mais ce confort apparent dissimule une réalité plus silencieuse, plus sourde : celle d’une nouvelle forme de pouvoir. Un pouvoir sans visage, sans Loi, sans discours.

Ce que la philosophe Antoinette Rouvroy appelle la gouvernementalité algorithmique n’est pas un complot. C’est une logique : faire en sorte que les sujets ne soient plus confrontés à des interdits, mais à des ajustements. Plus besoin d’interdire : il suffit d’orienter, d’influencer, de filtrer, de rendre certains comportements plus probables que d’autres.

L’individu prévisible

L’algorithme ne s’adresse pas à un sujet. Il traite un profil. Il ne reconnaît pas le désir, l’inconscient, la faille. Il calcule, anticipe, modélise. Ce qu’il produit, ce n’est pas une norme morale, mais une normalité statistique. Il ne sanctionne pas : il corrige.

Prenons l’exemple de Netflix. Si vous regardez des séries policières avec des femmes enquêtrice en rôle principal, la plateforme vous proposera à terme une série coréenne ou scandinave dans le même genre. Vous n’avez pas énoncé un désir, vous avez suivi une trace. Et cette trace est réinjectée sous forme d’offre. Votre goût est prédit plutôt que questionné.

Sur Instagram, les images que vous « likez » influencent l’ordre d’apparition des publications. Vous croyez faire des choix, mais l’ordre vous précède. Vous êtes dans un environnement adaptatif. Même chose pour la publicité : on ne vous impose plus un produit, on vous le fait apparaître au moment opportun, au milieu d’un flux qui a l’air neutre.

404.erreur, suspendu aux fils d’un système qui oriente sans interdire. L’interface Netflix agit ici comme paradigme d’un contrôle invisible, doux, mais total.

Une dépolitisation par les données

Ce qui se joue ici, c’est une dépolitisation insidieuse : plus besoin de lois conflictuelles ou de débats publics si l’on peut prévenir les effets déviants à l’avance. Le conflit est remplacé par l’efficacité. L’éthique par le design. La subjectivité par l’UX.

Les plateformes de santé numérique en sont un exemple. On vous propose de mieux dormir, de mieux manger, de mieux respirer. L’application vous félicite ou vous notifie, vous pousse à tenir vos objectifs. Il n’y a pas de jugement moral, mais une pression statistique : être dans la bonne moyenne.

Or, ce qui résiste, ce qui crée du lien, ce qui fonde une clinique, c’est justement ce qui ne se prévoit pas. Le ratage. Le lapsus. L’angoisse. L’événement. Tout ce que l’algorithme cherche à évacuer.

Le sujet raturé : un reste

Rouvroy parle d’un sujet raturé. Non pas disparu, mais effacé des opérations. Ce sujet reste pourtant, comme un rebut, un reste résistant à l’ingestion totale par les systèmes prédictifs. C’est ce qui fait trou. Ce qui échappe. Et donc : ce qui peut encore parler.

Ce blog, Tokyo Santé, prend acte de cette rature. Il ne cherche pas à prédire, ni à convaincre. Il cherche à faire entendre.

Car dans ce monde lisse, prévisible, fluidifié, il reste une chose qui ne passe pas : le symptôme.

Et lui, il parle.

Par 404.erreur